开源首发 | LET数据集开源首批超60,000分钟真机数据

近日,乐聚机器人正式开源全球首个面向真实作业场景的全尺寸人形机器人真机数据集 ——LET 数据集。首批超 60,000 分钟高质量数据已捐赠至开放原子开源基金会。

LET数据集是由乐聚智能(深圳)股份有限公司、国家地方共建人形机器人创新中心、北京数聚通启运营管理有限公司和苏州吴江智训未来运营管理有限公司联合主导构建。该数据集不仅精准填补具身智能领域高质量真机数据缺口,更为开发者、企业及科研团队提供 “开箱即用” 的标准化数据资产。

标准引领:国地共建 + 开源共享,破解行业痛点

LET 数据集以国家地方共建人形机器人创新中心规范为基准,通过统一采集与标准化处理,解决多源异构、格式不一、质量参差等行业问题,实现规模化高质量数据生产,为行业数据体系建设提供关键范本。同时双方正联合推进国家及行业标准研制,推动国家级标准化试点标准验证与实施应用。60,000+分钟数据经开放原子开源基金会捐赠开源,构建开放协同的产业生态。

规模化真机数据,60,000 + 分钟高质量供给

超 60,000 分钟高质量真机数据,为大模型 Scaling Law 验证提供优质基础,助力模型突破单纯动作模仿局限,实现从“机械执行”到“自主理解与推理”的能力跃迁。

统一真机实采,锻造高鲁棒性模型

基于乐聚夸父系列全尺寸人形机器人(40 + 自由度、1.66 米身高、55 公斤体重,搭载头部立体相机与腕部 RGB-D 相机)统一采集,有效规避机器人形态差异导致的数据偏差;结合真机实采的真实物理约束、环境扰动与传感器噪声,数据集一致性拉满,训练出的模型迁移能力与鲁棒性显著优于仿真数据模型,更适配复杂现实场景的端到端部署需求。

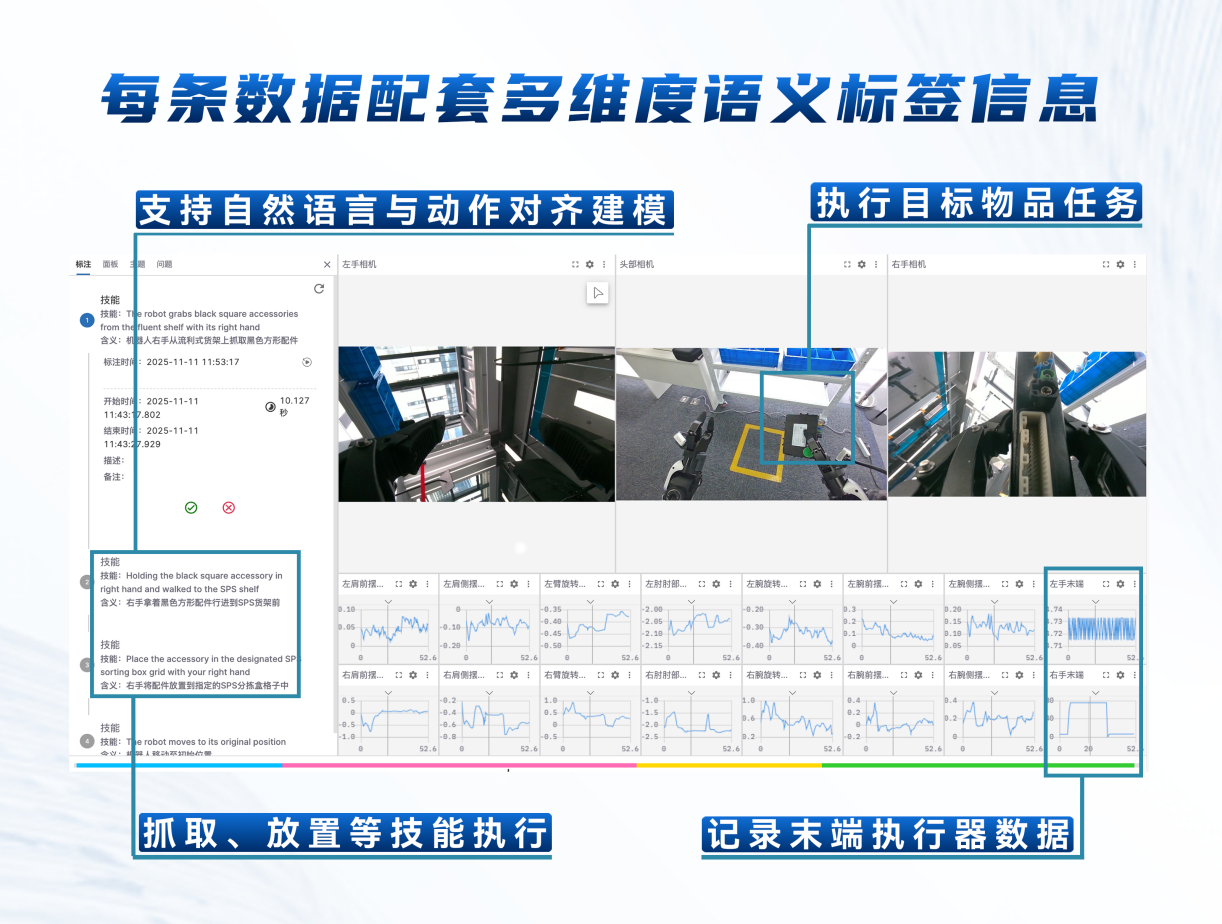

多模态数据融合,数据更精细标准

LET数据集融合机器人头部与双腕视角的清晰稳定视频流,同步采集 RGB 图像、深度图、关节状态、末端执行器状态等关键模态信息,全方位捕捉操作细节,为算法训练提供高一致、高完整的真机数据基础,助力模型贴近人类认知方式;同时构建系统的多模态对齐标注体系,通过细化任务标注与多维度语义标签,进一步提升数据质量标准。

六大真实作业场景,铸就强大泛化能力

LET 数据集聚焦真实作业场景,全面覆盖工业、商业零售、日常生活 3 大领域,包含汽车工厂、快消场景等 6 大细分场景、31 项任务及 117 种原子技能,场景具体涵盖汽车工厂、快消场景、3C工厂、酒店服务、生活服务及物流场景,包括抓取放置、工具使用、搬运、协作等典型任务,覆盖移动平台、机械臂抓取多种操作形态,能系统化支撑机器人算法的场景泛化能力,为复杂技能的学习与组合筑牢数据基础。

数采链三大技术创新,定义高质量数据

LET 数据集通过数采链路三大技术创新,系统性提升数据质量、对齐精度与模型可验证性。

1. 构建视觉伺服闭环数据:统一抽象坐标系与特征,解决多设备一致性难题,数据质量一致性超 90%;

2. 采用高效的组帧技术:将多传感器数据帧时间戳误差与延迟控制在 10ms 内,确保数据层时序同步;

3. 建立自动化Benchmark评测体系:全面评估数据收敛度、样本效率与稳定性,确保数据迁移有效性与泛化能力。

模型使用开发者友好

LET数据集提供了一套数据转换、模型训练、仿真测试与真机部署的全流程数据工具链,这将进一步推动具身智能行业的研发与落地。

真机数据应用案例

日化生产场景:日化产品定姿摆放

汽车制造场景:SPS零件分拣

物流场景:快递分拣应用

3C场景:传送带物料分拣应用

数据获取渠道

官方申请

官方邮箱:wangsong@lejurobot.com直接申请获取

公开平台

乐聚OpenLET社区

声明

本数据集基于 CC BY-NC-SA 4.0协议授权。

您可以自由地使用、修改和分享本数据集,但必须遵循以下条件:署名(注明原作者并链接至本协议)、非商业性使用,且任何衍生作品需以相同方式共享。