LET数据集更新|再度开源800条高质量灵巧操作数据!

近日,乐聚机器人再度开源800条高质量灵巧操作真机数据,已在乐聚OpenLET社区同步上线,面向全球开发者、科研团队免费开放获取。该数据聚焦真实作业场景的物理交互需求,填补具身智能领域“视觉-力触-动作”全链路数据缺口,为机器人精细操作研发提供关键数据支撑,助力社区生态协同创新。

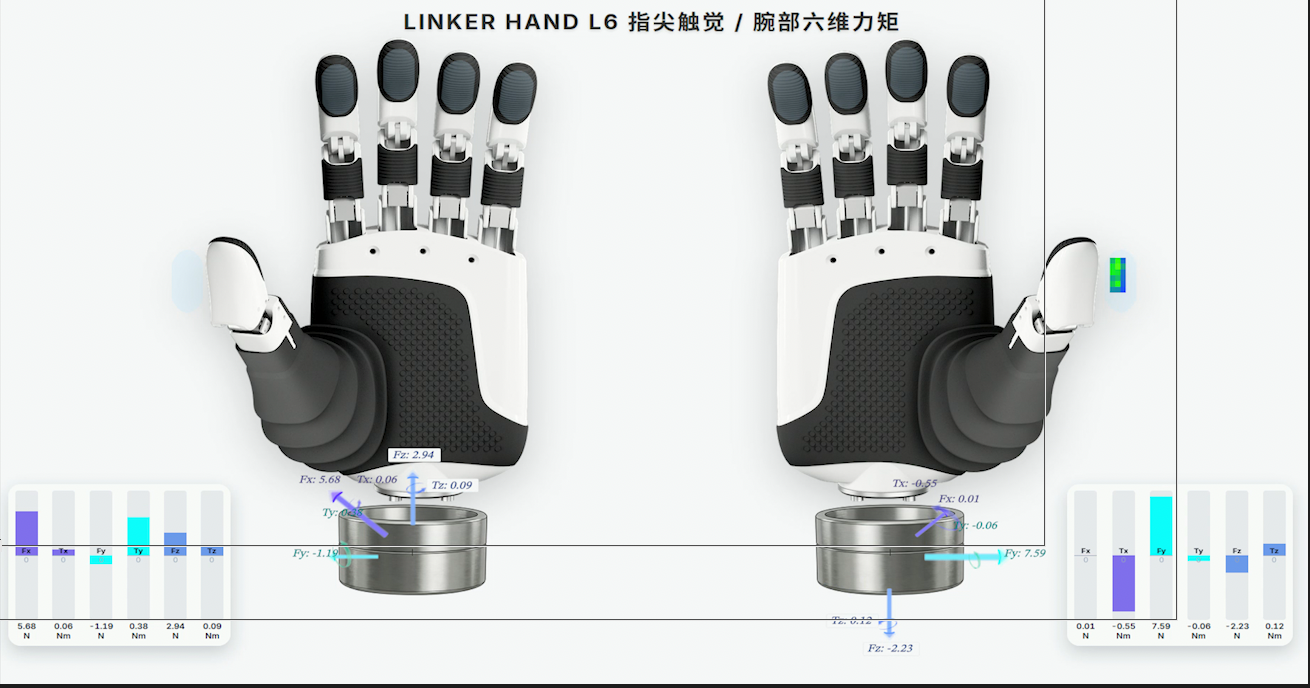

图:灵巧手

图:灵巧手

开源核心目标:破解“看得见摸不准”的行业痛点

当前机器人技术落地的核心瓶颈,在于高质量物理交互数据的缺失——现有数据多依赖视觉,难以支撑抓取、装配等场景对力度、材质的精准感知需求。此次开源的灵巧操作数据集,正是针对这一痛点,提供多维度、精细化的多模态数据,打通“视觉-力触-动作”全链路闭环,为产学研协同提升机器人感知控制能力提供关键支撑。

该数据集覆盖家庭、物流、日化三大核心领域,包含800条真机操作数据,涵盖快递分拣、快消上料、家庭物品抓取等典型任务,为行业数据体系建设提供可复用范本。

五大维度数据,全方位支撑精细操作研发

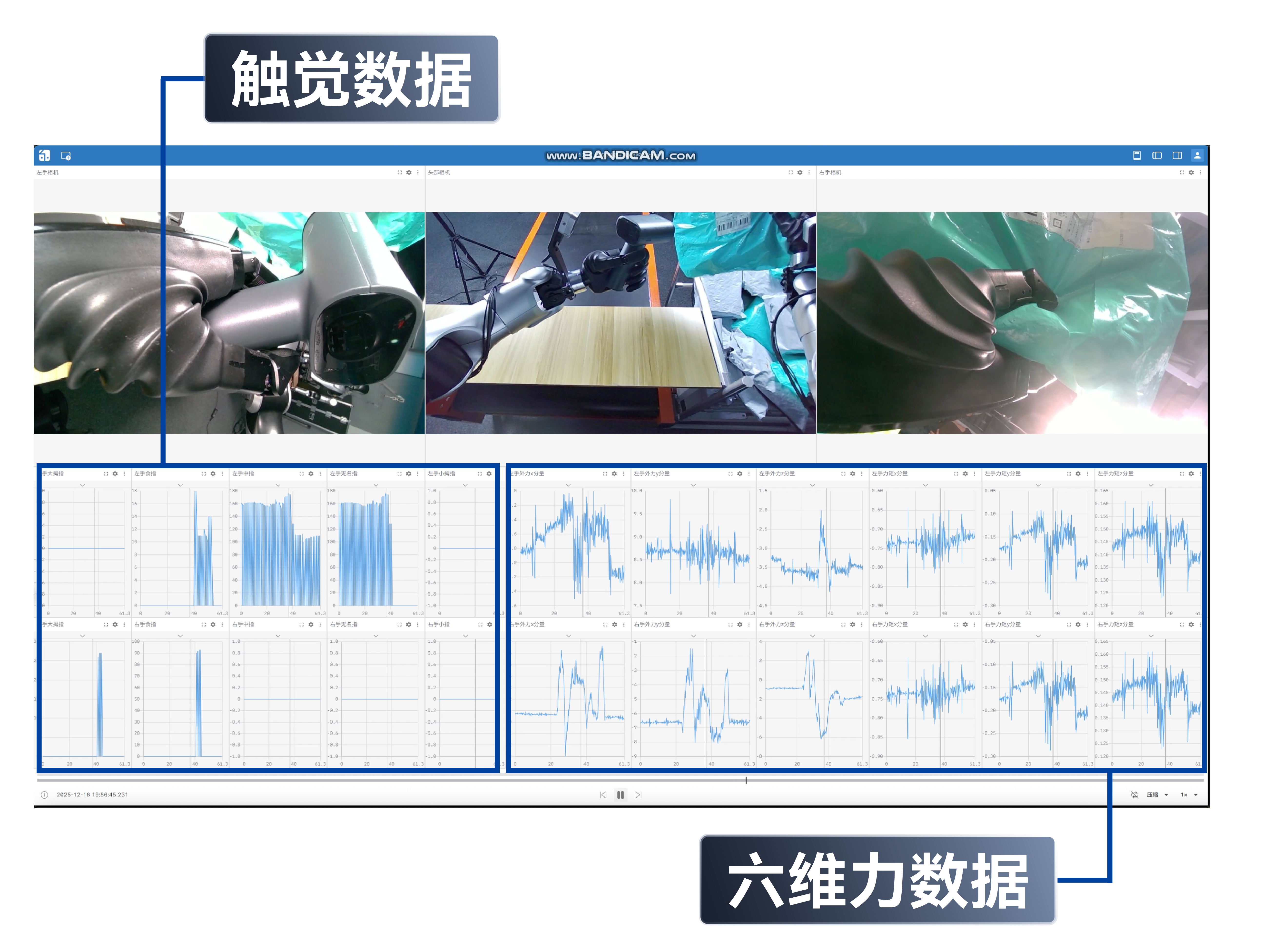

灵巧操作数据集新增触觉数据、六维力数据,全方位捕捉机器人操作细节,具体包含五大核心数据维度:

触觉阵列数据:6×12×5指尖触觉传感器采集的时序压力数据,能精准反映物体材质、形状和接触状态;

六维力数据:记录抓取、放置等动作的三维力和力矩信息,精度达±0.5%;

RGB-D视觉数据:高分辨率彩色图+稠密深度图,还原场景完整外观和三维信息;

同步动作信息:配套手部关节角度、速度等数据,实现“视觉-力触-动作”全链路对齐;

多场景标注:涵盖快递分拣、快消上料、家庭物品抓取等典型任务,每条数据均附带场景类型、物体材质、操作目标等多维度语义标签,支持自然语言与动作对齐建模。

硬核技术保障,数据质量更精细

统一采集设备:基于乐聚新一代灵巧手统一采集,规避设备差异导致的数据偏差;

灵巧手性能优势:160–185°/s关节速、0.35秒开合响应、±0.2毫米定位精度,搭配触觉+力传感系统,精准捕捉操作细节;

真实场景采集:覆盖家庭稳定抓取、快消无损放料、快递高效分拣等场景,数据具备高感知精度与实用性。

图:家庭稳定抓取

图:家庭稳定抓取

图:快消无损放料

图:快消无损放料

图:快递高效分拣

图:快递高效分拣

模型赋能显著,实现“操作得准”的跨越

优质数据直接驱动机器人模型训练效能与实用性双提升,推动机器人从“看得见”向“操作得准”跨越,其核心价值已在多个真实场景中得到验证:

任务成功率提升:在纸箱拆垛、顺丰快递分拣等场景验证,可通过触觉补偿解决条码遮挡等复杂情况;

环境感知升级:为力控策略优化、触觉-视觉融合模型提供数据支撑,打破纯视觉局限,构建稳定的物理交互闭环,提升复杂环境下的操作稳定性;

研发门槛降低:配套数据工具包与示例代码,开箱即用,缩短研发周期;

泛化能力增强:支撑机器人适配不同材质、形态物体,助力突破“仿真-现实”鸿沟,支撑具身大模型研究。

图:纸箱拆垛

图:纸箱拆垛

图:快递分拣

图:快递分拣

灵巧操作数据集的价值,在于为开发者提供“视觉-力触-动作”全链路的真实数据支撑,无论是触觉识别模型训练、抓取策略优化,还是力控算法验证、多模态融合研究,都能找到适配的学习样本,助力打通从“算法研究”到“产业验证”的落地链路。

图:数采系统画面

图:数采系统画面

现在,800条高质量灵巧操作LET数据已同步开放,诚邀各位开发者登录乐聚OpenLET社区获取数据、实践验证,同时欢迎分享你的应用案例、提交优化建议,让我们携手丰富物理交互数据生态,共同推动具身智能技术落地!

数据获取渠道

官方申请

官方邮箱:wangsong@lejurobot.com直接申请获取

公开平台

乐聚OpenLET社区:https://ai.atomgit.com/lejurobot/LET-touch-dataset/tree/main

声明

本数据集基于 CC BY-NC-SA 4.0协议授权。

您可以自由地使用、修改和分享本数据集,但必须遵循以下条件:署名(注明原作者并链接至本协议)、非商业性使用,且任何衍生作品需以相同方式共享。